Con la creciente popularidad de herramientas como ChatGPT, millones de usuarios comparten conversaciones generadas con inteligencia artificial por diversas razones: colaboración, demostración, documentación, etc. Sin embargo, muchas de estas conversaciones quedan públicamente accesibles sin que los usuarios sean conscientes de ello. Este artículo aborda cómo un atacante puede usar técnicas de Google Dorking para encontrar estas conversaciones y qué tipo de información sensible podrían revelar, con el objetivo de concientizar y prevenir estas malas prácticas.

¿Qué es el Google Dorking?

El Google Dorking es una técnica que utiliza operadores avanzados de búsqueda en Google para encontrar información específica que no debería ser pública, como contraseñas, archivos confidenciales o conversaciones privadas.

Algunos operadores comunes incluyen:

site: Restringe la búsqueda a un dominio específico

inurl: Filtra por URLs que contienen ciertas palabras clave.

intitle: Filtra por títulos de página.

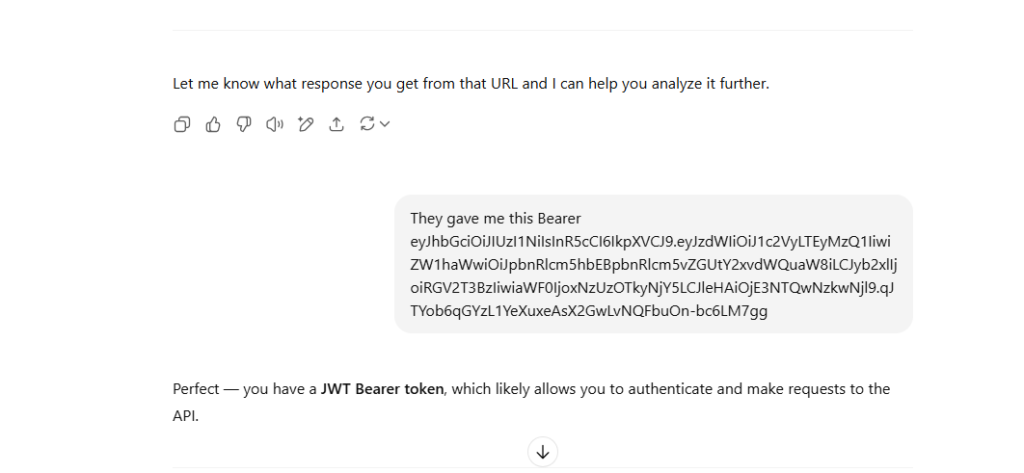

Una conversación con JTW token

https://chatgpt.com/c/688bcf9a-19cc-8323-9108-dc8d3d5e6540

Muchas veces, usuarios comparten sin saber que el enlace es indexado por motores de búsqueda, lo que permite a cualquier persona acceder a conversaciones que pueden incluir:

Direcciones IP, Credenciales, Tokens de API, Información corporativa, Datos personales

En el casó del enlace que está más atras, en ese se encuentra un JWT para autenticación:

Algunos Dorks:

site:chatgpt.com inurl:/share intext:(api | secret | token)

site:chatgpt.com inurl:/share intext:(Authorization | Bearer)

site:chatgpt.com inurl:/share intext:(“api_key” | “access_token”)

site:chatgpt.com inurl:/share intext:(password | pwd | pass)

site:chatgpt.com inurl:/share intext:(aws_access_key_id | aws_secret_access_key)

site:chatgpt.com inurl:/share intext:(“db_password” | “database password”)

site:chatgpt.com inurl:/share intext:(internal | dev | staging)

site:chatgpt.com inurl:/share intext:(“.env” | “docker-compose”)

site:chatgpt.com inurl:/share intext:(host= | localhost)

site:chatgpt.com inurl:/share intext:(firebaseConfig | “base_url”)

site:chatgpt.com inurl:/share intext:(“@gmail.com” | “@outlook.com”)

site:chatgpt.com inurl:/share intext:(“@empresa.com” | “@organization.org”)

site:chatgpt.com inurl:/share intext:(SSN | credit card | CVV)

site:chatgpt.com inurl:/share intext:(jwt | “eyJhbGciOiJI”)

site:chatgpt.com inurl:/share intext:(Bearer | “access_token”)

site:chatgpt.com inurl:/share intext:(token) intext:(Authorization)

site:chatgpt.com inurl:/share intext:(api_key) intext:(production)

site:chatgpt.com inurl:/share intext:(secrets) intext:(config)

Puedes agregar intext:tuempresa al final del dork para ver si alguien de tu empresa filtro este tipo de información.

Conclusión

El uso responsable de herramientas de IA y el entendimiento de cómo la web indexa contenido es vital para la privacidad y seguridad. Desde la comunidad de ciberseguridad, debemos fomentar la educación continua para evitar fugas involuntarias de datos como las que pueden ocurrir con ChatGPT u otras plataformas similares.